Intro to NLP

Intro to Natural Language Processing(NLP)

- Academic Disciplines related to NLP

- Treands of NLP

NLP(Natural Language Processing)

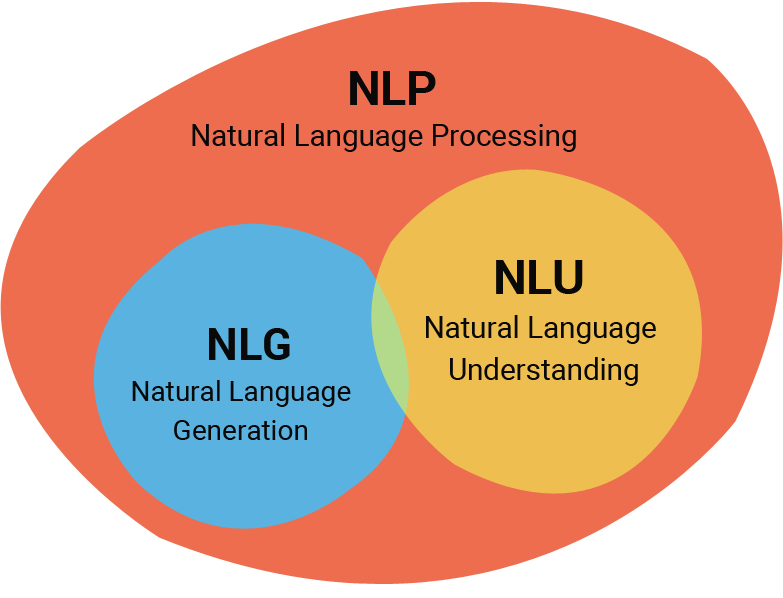

NLU(Natural Language Undestanding)과 LNG(Natural Language Generation이 존재

집합으로 표현하면 위 그림과 같다.

Natural language processing

NLP는 최첨단 딥러닝 모델 및 작업을 포함하고 있다.

Includes state-of-the-art deep

자연어 처리에서는 다양한 아래를 포함한 다양한 Task를 다루게 된다.

Low-level parsing

각 단어를 준비하기 위한 가장 low level의 task

- Tokenization

- 문장을 이루는 각 단어들을 정보 단위로 생각.

- 주어진 문장1을 단어(Token) 단위로 나누는 과정

- Stemming

- 어미 변화에 따른 의미 변화를 없애고 단어의 어근을 추출

Word and phrase level

- Named entity recognition(NER2)

- part-of-speech(POS3) tagging

- noun-phrase chunking

- dependency parsing

- coreference resolution

Sentence level

- Sentiment analysis

- 문장의 긍정/부정 판단

- machine translation

- 영어 문장을 한글 문장으로 번역

Multi-sentence and paragraph level

- Entailment prediction

- 두 문장의 논리적인 내포, 모순 관계 파악

- question answering

- 독해 기반의 질의 응답 (구글 검색에서 문장으로 질문 입력 시 답이 출력)

- dialog systems

- 챗봇 (대화 실행)

- summarization

- 문서 요약

Text mining

빅데이터 분석과 관련된 기술

- Extract useful information and insights from text and document data

- e.g., analyzing the trends of AI-related keywords from massive news data

- Document clustering (e.g., topic modeling)

- e.g., clustering news data and grouping into different subjects

- Highly related to computational social science

- e.g., analyzing the evolution of people’s political tendency based on social media data

Laplace smoothing

add - 1

| $P(x_i | c) = {\displaystyle count(x_i, c) + 1 \over \displaystyle \sum_{x\in V}{count(x, c) + 1}}$ |

$\displaystyle \sum_{x\in V}{count(x, c) + 1}$에서 1을 더해주는 이유는 계산한 확률이 0이 되지 않도록 하기 위해서. 1이 아닌 적당한 상수를 사용해줘도 된다.

1: Token들이 특정 순서로 이루어진 sequence

2: 단일 단어, 고유 단어 인식 task (New york times)

3: 단어의 품사나 성분을 알아내는 task (주어, 목적어, 동사 등)